Ethik und Sozialphilosophie der Digitalen Gesellschaft

Videos

re:publica 26: KI und der neue Faschismus. 18. Mai 2026, Berlin. Languages: 🇩🇪 + 🇬🇧 voiceover

NANO Talk (3sat/ZDF) am 09.04.2026: “Neuer Faschismus”, moderiert von Alena Buyx, mit Rainer Mühlhoff, Oliver Nachtwey, Sven Reichardt. Languages: 🇩🇪

Jung & Naiv, 02.04.2026: Rainer Mühlhoff, Philosoph über Künstliche Intelligenz und Faschismus. Languages: 🇩🇪

NANO Talk (3sat/ZDF) am 22.01.2026: “Neuer Kolonialismus – Kampf um Macht in neuen Sphären”, moderiert von Stephanie Rohde, mit Rainer Mühlhoff, Lena Ulbricht und Aram Ziai. Languages: 🇩🇪

Chatbots im Schulunterricht!? (mit Marte Henningsen). Chaos Communication Congress 38c3, 28 December 2024, Hamburg, Germany. Languages: 🇩🇪 + 🇬🇧 live translation Watch:

Neuigkeiten | Termine

Vortrag: “Faschismus und KI” – Aktionswoche “Wissenschaft gegen Faschismus”

Veranstaltung im Rahmen der bundesweiten Aktionswoche “Wissenschaft gegen Faschismus”. Organisiert vom AStA der Universität Osnabrück.

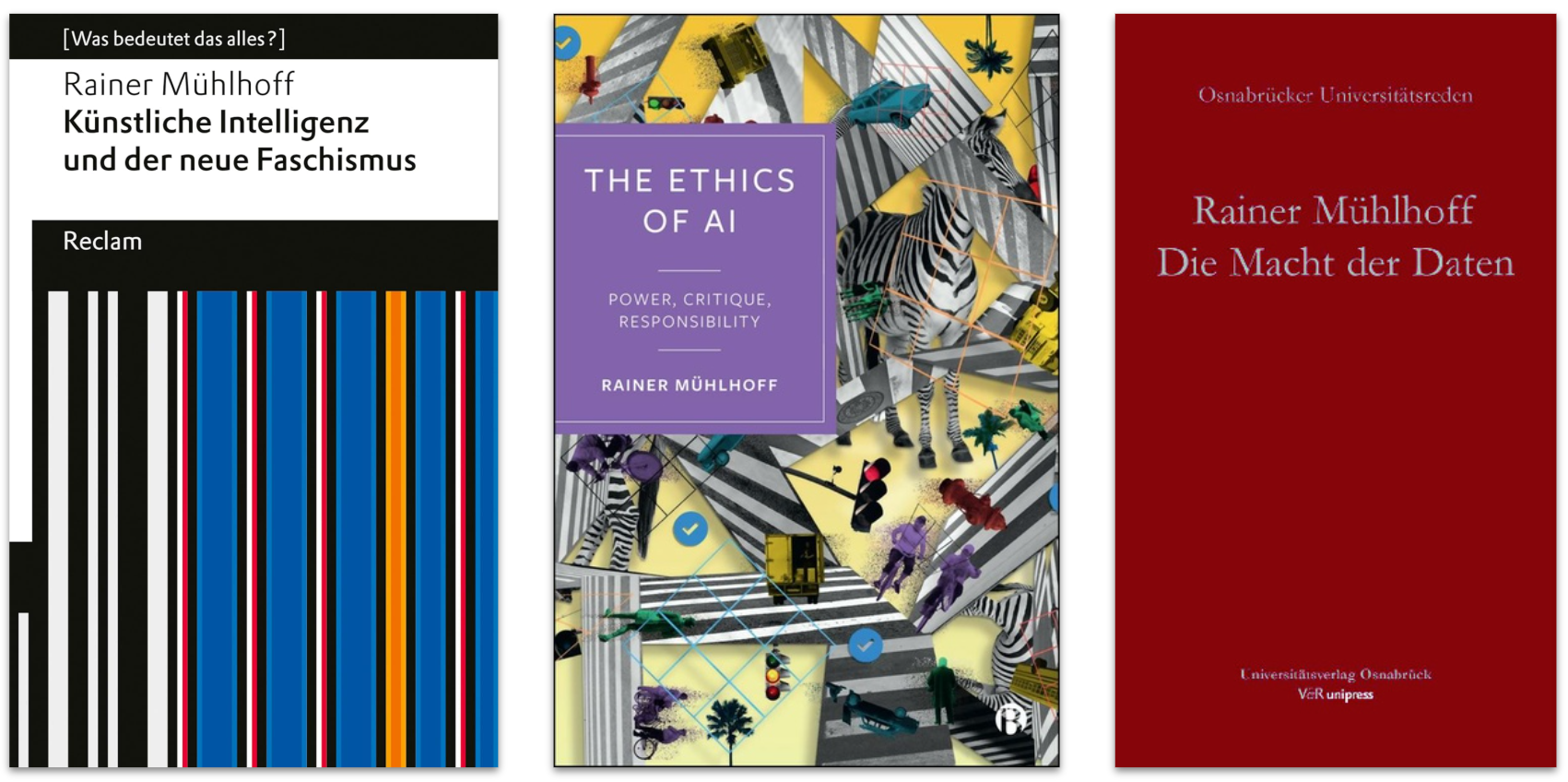

Buchpreis „Das politische Buch 2026“ für Künstliche Intelligenz und der neue Faschismus

Ich freue mich sehr über eine besondere Auszeichnung: Mein Buch Künstliche Intelligenz und der neue Faschismus (Reclam) wird mit dem Preis „Das politische Bu...

re:publica 26: Montag, 17:30 Uhr, Stage 1: “KI und der neue Faschismus”

Ich bin in diesem Jahr bei der re:publica 26 in Berlin mit einem eingeladenen Talk dabei. Thema ist mein neues Buch Künstliche Intelligenz und der neue Fasch...

Talkshow-Gast bei NANO Talk (3sat)

Sendung vom 09.04.2026, “Neuer Faschismus – Freie Wahlen in die Unfreiheit”, moderiert von Alena Buyx, mit Rainer Mühlhoff, Oliver Nachtwey und Sven Reichard...

Zu Gast bei Jung & Naiv

Interview mit Tilo Jung (Jung & Naiv) vom 02.04.2026: Rainer Mühlhoff über Künstliche Intelligenz und Faschismus.

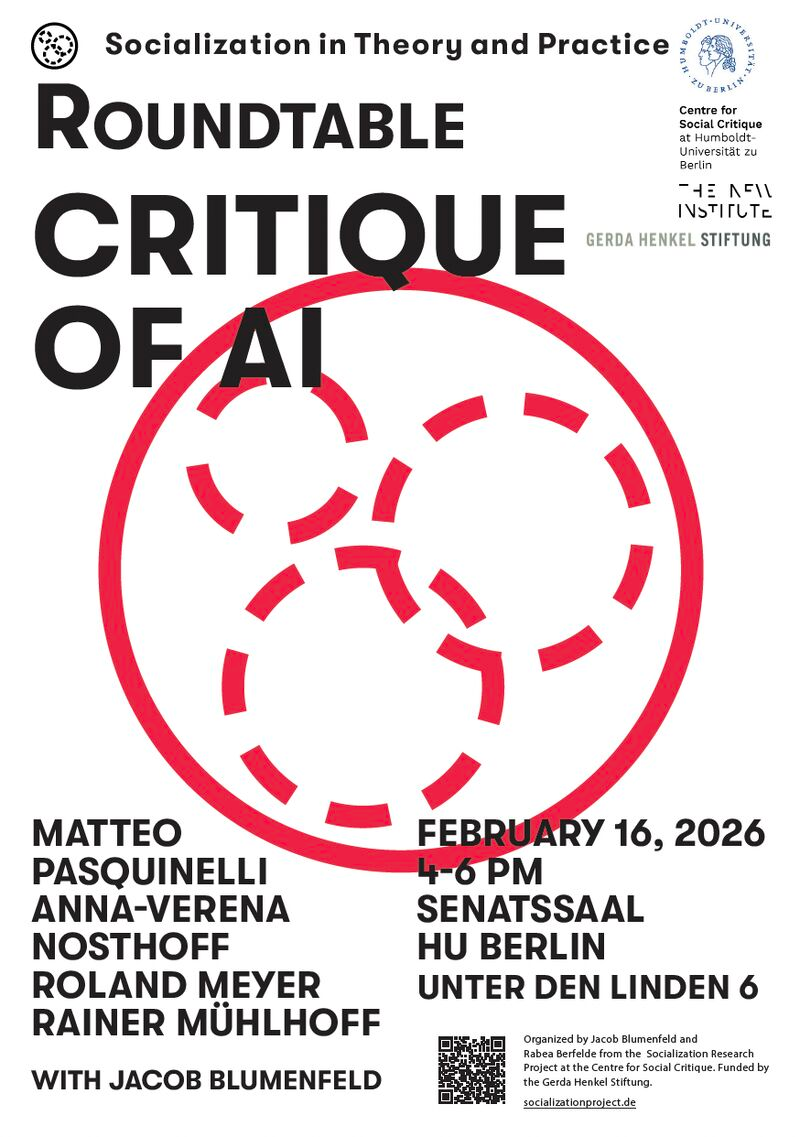

“Critique of AI” Roundtable – HU Berlin

Diskussion mit Roland Meyer, Rainer Mühlhoff, Anna-Verena Nosthoff, Matteo Pasquinelli, organisiert von Jacob Blumenfeld und Critical Theory in Berlin.

Marie-Luise Angerer Lecture, transmediale, Berlin

Es ist mir eine Ehre, bei der diesjährigen Marie-Luise Angerer Lecture im Rahmen des transmediale Festivals in Berlin zu präsentieren. Gemeinsam mit Teresa C...

Talkshow-Gast bei NANO Talk (3sat)

Sendung vom 22.01.2026, “Neuer Kolonialismus – Kampf um Macht in neuen Sphären”, moderiert von Stephanie Rohde, mit Rainer Mühlhoff, Lena Ulbricht und Aram Z...

Keynote: Demokratie und die ideologische Macht der KI, Akademie für Politische Bildung, Tutzing

Keynote zu meinem Buch “KI und der neue Faschismus” (Reclam) im Rahmen der Tagung “Auf dem Weg zum digitalen Autoritarismus? Aktuelle gesellschaftliche und e...

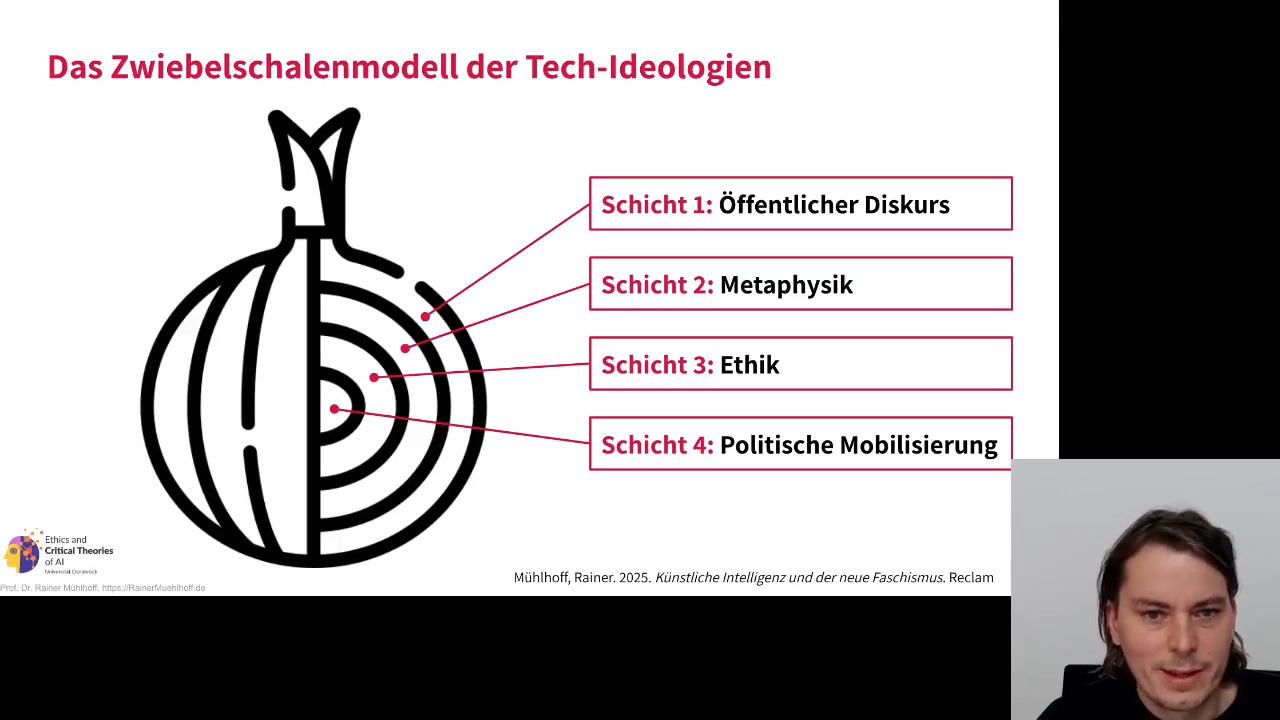

Keynote am Weizenbaum-Institut: The Power of AI – From Tech Ideologies to New Authoritarianisms

🗓️ Donnerstag 20.11.2025, 18:30–20:00 Uhr 📍 Weizenbaum-Institut, Hardenbergstraße 32, 10623 Berlin

Neues BMFTR-Projekt bewilligt: Künstliche Intelligenz und Demokratie

Das Bundesministerium für Forschung, Technologie und Raumfahrt fördert unser Projekt „KI und Demokratie: Rechtsstaat, Teilhabe, Nachhaltigkeit“ im Zeitraum 1...

What’s Left? Die dunkle Seite des Silicon Valley: Tech-Eliten vs. Demokratie”

Diskussion bei der Friedrich-Ebert-Stiftung, mit: Francesca Bria, Aya Jaff, Tim Klüssendorf, Rainer Mühlhoff.

Bei Topoi e.V. in Berlin: “KI und der neue Faschismus”

Öffentlicher Vortrag und Diskussion bei Topio e.V. zu meinem Buch KI und der neue Faschismus (Reclam, 2025).

Video: Keynote auf der “KI-Woche” des LfDI Baden-Württemberg in Stuttgart

🗓️ Montag 3. November 2025, 16:00 Uhr 📍 Lautenschlagerstraße 20, 70173 Stuttgart